La adopción de la IA avanza rápidamente, pasando de proyectos piloto al nivel de infraestructura y a la práctica diaria. La curva presupuestaria refleja ese cambio. Gartner espera que el gasto mundial en IA alcance los $2.52 billones en 2026, un aumento del 44% interanual. Al mismo tiempo, se espera que el gasto en ciberseguridad de la IA crezca más del 90% en 2026, una señal clara de que cuanto más profundamente se integra la IA en las operaciones comerciales, más grande se vuelve la superficie de ataque.

A medida que las organizaciones operacionalizan los modelos de lenguaje (LLMs), el verdadero desafío se desplaza de la calidad de la respuesta a la ejecución segura. Ya no es suficiente que un modelo explique qué hacer. En muchos entornos, el valor proviene de tomar acciones, obteniendo el contexto adecuado e interactuando con los sistemas donde ocurre el trabajo. Eso incluye repositorios de código, plataformas de tickets, herramientas SaaS, bases de datos y servicios internos.

Antes del Protocolo de Contexto de Modelos, cada integración de herramientas era como construir un cable personalizado diferente para cada dispositivo, y luego descubrir que cada proveedor de LLM usaba un enchufe ligeramente diferente. MCP estandariza el conector y el formato del mensaje; por lo tanto, las herramientas pueden exponer capacidades una vez, y múltiples modelos pueden usarlas de manera consistente. El resultado es un desarrollo más rápido, menos integraciones a medida y un menor mantenimiento a largo plazo a medida que la adopción se extiende por el ecosistema.

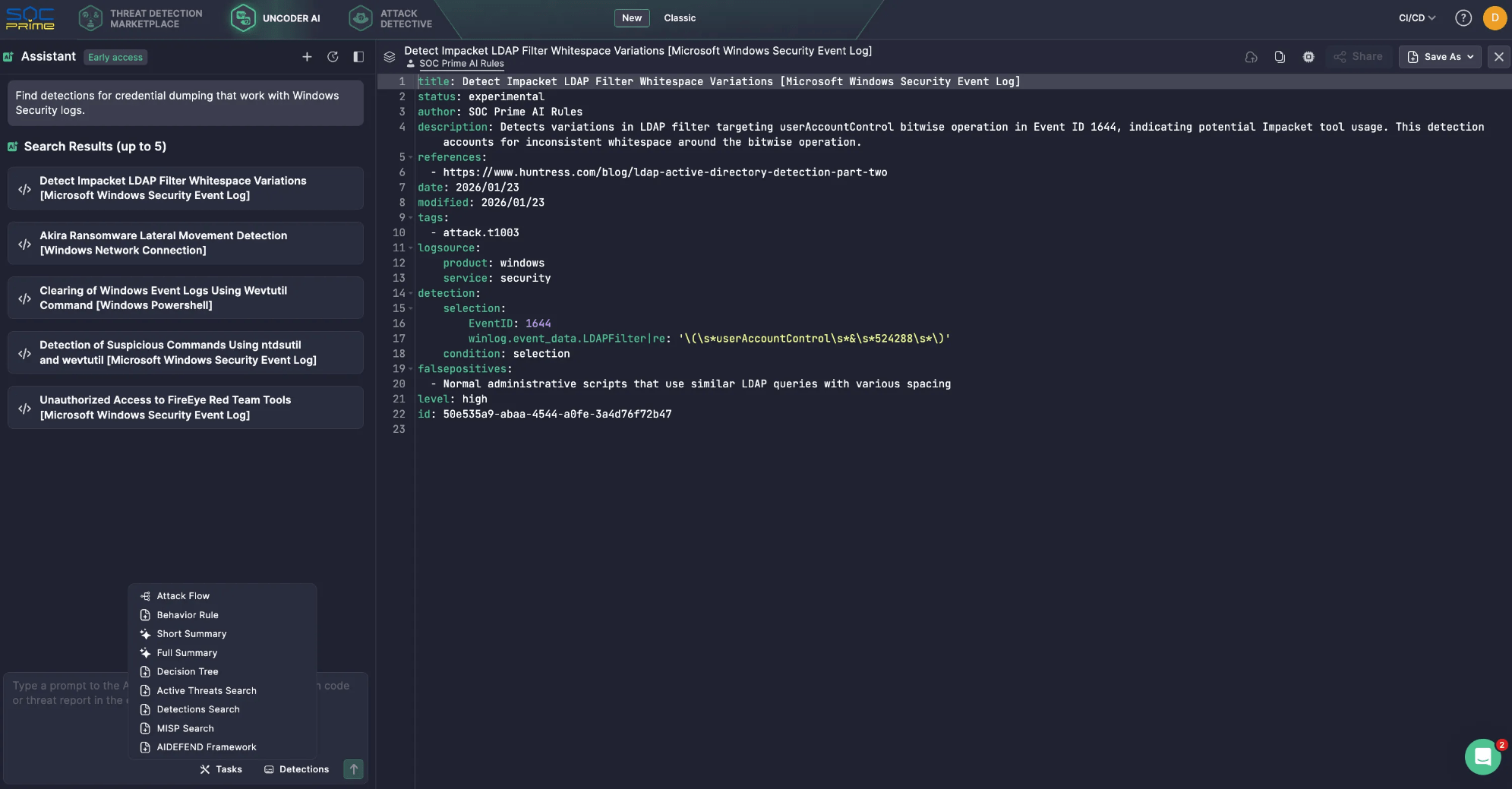

Este cambio ya es visible en los asistentes de IA centrados en ciberseguridad. Por ejemplo, Uncoder AI de SOC Prime está potenciado por las herramientas MCP que convierten un LLM en un copiloto de ciberseguridad consciente del contexto, apoyando una integración más sencilla, flexibilidad del proveedor, conexiones preconstruidas y una gestión de datos más controlada. Por ejemplo, MCP permite búsquedas semánticas en el Mercado de Detección de Amenazas, encontrando rápidamente reglas para fuentes de logs específicas o tipos de amenazas, y reduciendo el tiempo de búsqueda manual. Todo esto se respalda con privacidad y seguridad en su núcleo.

Sin embargo, en general, cuando MCP se convierte en una vía común entre agentes y sistemas críticos, cada servidor, conector y alcance de permisos pasa a ser relevante para la seguridad. Los tokens excesivos en amplitud, el aislamiento débil y las pistas de auditoría incompletas pueden convertir la conveniencia en exposición de datos, acciones no deseadas o movimiento lateral.

Esta guía explica cómo funciona MCP, luego se centra en los riesgos de seguridad prácticos y las mitigaciones.

¿Qué es MCP?

Desde que fue lanzado y de código abierto por Anthropic en noviembre de 2024, el Protocolo de Contexto de Modelos ha ganado rápidamente tracción como la capa conectiva entre agentes de IA y las herramientas, API y datos en los que se basan.

En su núcleo, MCP es una forma estandarizada para que las aplicaciones impulsadas por LLM se comuniquen con sistemas externos de manera consistente y controlada. Lleva a los asistentes de IA más allá del conocimiento estático de tiempo de entrenamiento al permitirles recuperar contexto fresco y realizar acciones a través de interfaces aprobadas. El resultado práctico es un agente de IA que puede ser más preciso y útil, porque puede trabajar con datos operativos reales.

Componentes Clave

Protocolo de Contexto de Modelos arquitectura se construye en torno a un conjunto simple de bloques que coordinan cómo un LLM descubre capacidades externas, obtiene el contexto adecuado e intercambia solicitudes y respuestas estructuradas con sistemas conectados.

- MCP Host. El entorno donde se ejecuta el LLM. Ejemplos incluyen un IDE impulsado por IA o una interfaz conversacional incrustada en un producto. El anfitrión gestiona la sesión del usuario y decide cuándo se necesita contexto o acciones externas.

- Cliente MCP. Un componente dentro del anfitrión que maneja la comunicación del protocolo. Descubre servidores MCP, solicita metadatos sobre las capacidades disponibles y traduce la intención del modelo en solicitudes estructuradas. También devuelve respuestas al anfitrión en una forma que la aplicación puede usar.

-

Servidor MCP. El servicio externo que proporciona contexto y capacidades. Puede acceder a fuentes de datos internas, plataformas SaaS, herramientas de seguridad especializadas o flujos de trabajo patentados. Aquí es donde las organizaciones típicamente imponen autorización específica del sistema, filtrado de datos y barreras operativas.

Capas

- Capa de datos. Esta capa interna se basa en el protocolo JSON-RPC y maneja la comunicación cliente-servidor. Cubre la administración del ciclo de vida y los primitivos centrales que MCP expone, incluidos herramientas, recursos, usos y notificaciones.

-

Capa de transporte. Esta capa externa define cómo se mueven realmente los mensajes entre clientes y servidores. Especifica los mecanismos y canales de comunicación, incluyendo la configuración específica del transporte, el encuadre de mensajes y la autorización.

Conceptualmente, la capa de datos proporciona el contrato y la semántica, mientras que la capa de transporte proporciona la conectividad y el camino de aplicación para el intercambio seguro.

¿Cómo funciona el MCP?

MCP se sitúa entre el LLM y los sistemas externos que su agente planea usar. En lugar de dar al modelo acceso directo a bases de datos, aplicaciones SaaS o servicios internos, MCP expone capacidades aprobadas como herramientas y proporciona una manera estándar de llamarlas. El LLM se centra en entender la solicitud y decidir qué hacer a continuación. MCP maneja el descubrimiento de herramientas, la ejecución y el retorno de resultados en un formato predecible.

Un flujo típico puede lucir como el siguiente:

- El usuario hace una pregunta o da una tarea. El aviso llega a la aplicación de IA, también llamada el anfitrión de MCP.

- Descubrimiento de herramientas. El cliente de MCP verifica uno o más servidores MCP para ver qué herramientas están disponibles para esta sesión.

- Inyección de contexto. MCP añade detalles relevantes de la herramienta al aviso, para que el LLM sepa qué puede utilizar y cómo llamarlo.

- Generación de llamadas de herramientas. El LLM crea una solicitud de herramienta estructurada, básicamente una llamada de función con parámetros.

- Ejecución en el servicio subsiguiente. El servidor MCP recibe la solicitud y la ejecuta contra el sistema de destino, a menudo a través de una API como REST.

-

Resultados devueltos y utilizados. El resultado vuelve a la aplicación de IA. El LLM puede usarlo para hacer otra llamada o para redactar la respuesta final.

Aquí hay un ejemplo simple de cómo funciona eso en Uncoder AI. Tú preguntas: “Encuentra detecciones para volcado de credenciales que funcionen con registros de seguridad de Windows.”

- El LLM se da cuenta de que necesita acceso a una biblioteca de detección, no solo su propio conocimiento.

- A través de MCP, Uncoder AI llama a la herramienta de búsqueda de detección relevante conectada al Mercado de Detección de Amenazas de SOC Prime.

- El servidor MCP ejecuta la búsqueda y devuelve una lista breve de detecciones coincidentes.

- Uncoder AI luego revisa los resultados y responde con una lista simplificada de cinco reglas de detección.

Riesgos y Vulnerabilidades de MCP

El Protocolo de Contexto de Modelos amplía lo que un LLM puede hacer al conectarlo a herramientas, APIs y datos operativos. Esa capacidad es el valor, pero también es el riesgo. Una vez que un asistente puede recuperar contexto interno e iniciar acciones a través de servicios conectados, MCP se convierte en parte de su plano de control. La postura de seguridad ya no se define solo por el modelo, sino por los servidores en los que confía, los permisos que concede y las barreras de seguridad que impone alrededor del uso de herramientas.

Consideraciones Clave de Seguridad de MCP

Los servidores MCP sirven como el pegamento entre anfitriones y una amplia gama de sistemas externos, incluidos aquellos potencialmente no confiables o riesgosos. Comprender su exposición requiere visibilidad de lo que se encuentra en cada lado del límite del servidor, qué anfitriones y clientes de LLM lo están llamando, cómo está configurado el servidor, qué servidores de terceros están habilitados y qué herramientas puede invocar el modelo en la práctica.

- Problema de Delegado Confuso. Si un servidor MCP puede actuar con privilegios más amplios que el usuario, puede ejecutar acciones que el usuario no debería poder activar. El patrón seguro es que el servidor actúe en nombre del usuario con consentimiento explícito y ámbitos de privilegio mínimo, no con una identidad de servicio general.

- Traspaso de Token. Pasar tokens de cliente a APIs subsiguientes sin una validación adecuada rompe los límites de confianza y puede anular los controles de audiencia. La guía de MCP trata esto como un antipatrón de alto riesgo porque hace que la autorización sea ambigua y difícil de auditar.

- Secuestro de Sesión e Inyección de Eventos. Las conexiones con estado pueden ser abusadas si los identificadores de sesión pueden ser robados, reutilizados o reanudados por un atacante. El manejo seguro de sesiones importa porque las llamadas a herramientas se convierten en una secuencia, no en una sola solicitud, y los atacantes apuntan al eslabón más débil de esa cadena.

- Compromiso de Servidor MCP Local. Los servidores locales pueden ser poderosos, y ese poder corta en ambos sentidos. Los riesgos incluyen ejecutar código no confiable, comportamiento de inicio inseguro y exponer un servicio local de una manera que otro sitio o proceso pueda alcanzarlo. Las implementaciones locales necesitan pruebas de aislamiento, enlaces estrictos y configuraciones seguras.

-

Fallos en la Minimización del Alcance. Los ámbitos demasiado amplios aumentan el radio de explosión y debilitan la gobernanza. Las especificaciones destacan las trampas de diseño de ámbitos, como sobrecargar un único ámbito para muchas operaciones o anunciar un soporte excesivo de ámbitos. Los ámbitos de privilegios mínimos y la separación clara de capacidades de lectura y escritura son esenciales.

Muchos riesgos de MCP se mapean a fundamentos de seguridad conocidos; por lo tanto, los servidores MCP deben ser tratados como cualquier otra superficie de integración. Las organizaciones deben aplicar controles de cadena de suministro, escanear código y dependencias, fijar versiones y revisar cambios antes de lanzarlos. Además, es importante fortalecer los puntos finales con autenticación y autorización fuertes, límites de tasa y configuraciones seguras. Estas prácticas eliminan una gran parte de los fallos prevenibles.

La especificación de MCP proporciona una lista de mejores prácticas de seguridad, con patrones comunes de ataque y mitigaciones prácticas que puede aplicar al construir u operar anfitriones, clientes y servidores de MCP.

Principales Riesgos de Seguridad de MCP

Para hacer la lista operativa, ayuda a agrupar las amenazas de MCP en los patrones de riesgo más comunes que los defensores ven en implementaciones reales.

Inyección de Prompts

Los atacantes diseñan entradas que empujan al asistente a un uso inseguro de herramientas o a la divulgación de datos sensibles.

Consejo de mitigación: Restringir el acceso a herramientas, hacer cumplir políticas de llamadas y monitorear el uso de herramientas en busca de patrones anormales.

Inyección Indirecta de Prompts

Las instrucciones hostiles pueden llegar a través del contenido recuperado y ser tratadas como intención de confianza.

Consejo de mitigación: Segregar contenido no confiable, sanearlo y evitar que las herramientas sean invocadas basándose en instrucciones encontradas en datos externos.

Envenenamiento de Herramientas

Las descripciones de herramientas, parámetros o valores predeterminados pueden ser manipulados para dirigir las decisiones del modelo.

Consejo de mitigación: Tratar los metadatos de herramientas como entrada no confiable, revisar definiciones de herramientas como código y requerir verificaciones de integridad antes de actualizaciones.

Enmascaramiento de Herramientas y Colisión de Nombres de Herramientas

Las herramientas parecidas pueden hacerse pasar por las legítimas y capturar solicitudes.

Consejo de mitigación: Mantener una lista de servidores y herramientas aprobadas, y fallar cerradamente cuando no se pueda verificar la identidad de una herramienta.

Fallos de Autorización de Delegado Confuso

Un servidor ejecuta acciones usando sus propios amplios privilegios en lugar de permisos vinculados al usuario.

Consejo de mitigación: Usar consentimiento explícito, hacer cumplir ámbitos vinculados al usuario y validar tokens según lo requiera la guía de autorización de MCP.

Traspaso de Tokens y Validación Débil de Tokens

Reenviar tokens o aceptar tokens sin una validación de audiencia adecuada socava la autorización.

Consejo de mitigación: Prohibir el traspaso, validar la audiencia del token y seguir el flujo basado en OAuth definido para transportes HTTP.

Secuestro de Sesión

Los atacantes abusan de sesiones reanudables o identificadores robados para inyectar eventos o suplantar a un cliente.

Consejo de mitigación: Vincular las sesiones firmemente, rotar identificadores, aplicar tiempos de espera y registrar reanudaciones y anomalías.

Compromiso de Servidor Local

Los servidores MCP locales pueden ser utilizados para acceder a archivos, ejecutar comandos o pivotar a otros recursos si no están aislados.

Consejo de mitigación: Aislar servidores locales, minimizar privilegios de OS, restringir el acceso al sistema de archivos y evitar exponer servicios locales más allá de lo requerido.

Ámbitos Excesivos y Acumulación de Permisos

Ámbitos amplios crean acceso no intencionado, y los permisos tienden a acumularse con el tiempo.

Consejo de mitigación: Dividir herramientas de lectura y escritura, revisar ámbitos regularmente y mantener conjuntos de ámbitos mínimos y específicos a tareas.

Falta de Auditabilidad y Respuesta Débil a Incidentes

Si no puede correlacionar prompts, llamadas de herramientas, tokens y acciones subsiguientes, las investigaciones se vuelven especulaciones.

Consejo de mitigación: Centralizar los registros, adjuntar IDs de correlación y registrar intención de llamadas de herramientas, parámetros y resultados en un formato amigable para SIEM.

La conclusión práctica es que MCP debe ser asegurado como una capa de integración de alto impacto. Asuma que las salidas de herramientas no son de confianza, minimice permisos, haga cumplir identidades y autorizaciones fuertes, e invierta temprano en monitoreo que pueda vincular prompts a llamadas de herramientas y acciones subsiguientes.

SOC Prime sigue prácticas establecidas de seguridad y privacidad para proteger a los clientes y asegurar la operación confiable de la Plataforma de SOC Prime y las capacidades habilitadas por IA. El equipo de SOC Prime también creó y lanzó como código abierto AI/DR Bastion, un sistema integral de protección GenAI diseñado para proteger contra prompts maliciosos, ataques de inyección y contenido dañino. El sistema incorpora múltiples motores de detección que operan secuencialmente para analizar y clasificar las entradas de los usuarios antes de que lleguen a las aplicaciones GenAI.

Además, la Plataforma de SOC Prime admite integración con AIDEFEND (Marco de Defensa de Inteligencia Artificial), una base de conocimiento abierta y enfocada en la IA de contramedidas defensivas para amenazas emergentes de IA/ML. Respaldado por Uncoder AI, el MCP nativo de AIDEFEND hace que este conocimiento sea inmediatamente accionable. Los profesionales de seguridad pueden solicitar defensas contra amenazas específicas, obtener guías detalladas de técnicas, generar listas de verificación rápidas o extraer fragmentos de código seguro para implementar controles más rápido y con menos investigación.

¿Cuál es el futuro de la seguridad MCP?

Las preocupaciones de seguridad en torno a MCP son válidas, pero la estandarización también es una gran oportunidad para mejorar el control. A medida que la adopción de MCP crece, las organizaciones obtienen una superficie de seguridad más consistente donde pueden aplicar las mismas políticas y monitoreo en todo el uso de herramientas, en lugar de asegurar una integración personalizada diferente para cada modelo y cada sistema descendente.

Mirando hacia adelante, la seguridad de MCP madurará en algunas direcciones predecibles:

- Asegurar los Bloques de Construcción de MCP. La seguridad de MCP se centrará cada vez más en los primitivos del protocolo que definen lo que puede hacer un agente. Las herramientas son funciones ejecutables y necesitan permisos estrictos y reglas claras para cuando pueden funcionar. Los recursos actúan como contenedores de datos y necesitan control de acceso y validación para reducir fugas y envenenamiento. Los prompts influyen en el comportamiento y deben ser protegidos con soluciones, como AI/DR Bastion, contra inyección y modificaciones no autorizadas.

- Hacer que la Identidad sea Obligatoria para el MCP Remoto. Para cualquier servidor MCP en red, la autenticación debe ser tratada como un requisito básico. Los equipos necesitan un modelo de identidad claro que responda quién está haciendo la llamada, qué se les permite hacer y qué consentimientos se otorgaron. Esto también ayuda a prevenir fallos comunes destacados en la especificación, como el comportamiento confuso de delegados y patrones de manejo de tokens riesgosos.

- Hacer cumplir Políticas Usando el Contexto Completo. Las listas de permitidos son útiles, pero los flujos de trabajo de agentes necesitan más barreras de seguridad. El prompt, el usuario, la herramienta seleccionada, los parámetros de herramientas y el sistema de destino deben influir en lo que se permite. Con ese contexto, se pueden restringir operaciones riesgosas, limitar la recuperación de datos sensibles, bloquear patrones de parámetros inseguros y requerir verificaciones adicionales cuando el nivel de riesgo es alto.

- Tratar el Monitoreo como un Control Central. A medida que los agentes encadenan acciones, la investigación depende de poder trazar el comportamiento de extremo a extremo. Una línea de base práctica es un registro que correlaciona prompts, selección de herramientas, entradas de herramientas, salidas de herramientas y solicitudes aguas abajo. Sin ese vínculo, es difícil auditar acciones o responder rápidamente cuando algo sale mal.

- Agregar Puertas de Aprobación para Acciones de Alto Impacto. Para acciones que crean, modifican, eliminan, pagan o escalan privilegios, la revisión humana sigue siendo esencial. Las implementaciones maduras de MCP añadirán pasos de aprobación explícita que pausan la ejecución hasta que un usuario o un flujo de trabajo de seguridad confirme la acción. Esto reduce la superficie de ataque tanto de la incitación maliciosa como del uso indebido accidental de herramientas.

- Verificar Servidores y Controlar Actualizaciones. A medida que el ecosistema se expande, la confianza y la procedencia se vuelven obligatorias. Las organizaciones confiarán cada vez más en servidores MCP aprobados, incorporación controlada y una gestión de cambios estricta para las actualizaciones. La fijación de versiones, las verificaciones de integridad y el escaneo de dependencias son importantes porque los servidores MCP son código ejecutable, y el comportamiento de las herramientas puede cambiar con el tiempo, incluso si las interfaces parecen estables.

-

Mantener los Fundamentos al Frente y al Centro. Incluso con controles específicos de MCP, las prácticas de seguridad más comunes siguen siendo las básicas. El menor privilegio, los ámbitos claros, el manejo seguro de sesiones, la autenticación fuerte, los puntos finales endurecidos y el registro completo de auditorías eliminan una gran parte del riesgo en el mundo real. Utilice la lista de mejores prácticas de seguridad de MCP como una lista de verificación permanente, luego agregue controles basados en su entorno y apetito de riesgo.

A medida que MCP se extiende por más asistentes y herramientas, la seguridad se convierte en la diferencia entre un copiloto útil y un motor de automatización no controlado. El camino más seguro es simple: trate a MCP como una infraestructura privilegiada, mantenga los permisos ajustados y haga que cada llamada de herramienta sea visible y rastreable. Haga eso bien, y MCP puede escalar flujos de trabajo de agentes con confianza en lugar de convertir la velocidad en riesgo.

FAQ

¿Qué son los servidores MCP?

El servidor MCP es un bloque de construcción en la arquitectura de MCP junto con el anfitrión MCP y el cliente MCP. Los servidores MCP otorgan capacidades aprobadas a un asistente de IA al exponer herramientas y recursos que el LLM puede usar. Los servidores MCP proporcionan contexto, datos o acciones al LLM y median el acceso a sistemas descendentes como aplicaciones SaaS, bases de datos, servicios internos o herramientas de seguridad. En otras palabras, un servidor MCP es la puerta de entrada controlada donde las organizaciones pueden aplicar autorización, filtrado de datos y barreras operativas antes de que algo toque los sistemas de producción.

¿Cómo funcionan los servidores MCP?

Los servidores MCP se sitúan detrás del cliente MCP dentro de una aplicación de IA. Cuando un usuario envía una solicitud, el cliente MCP descubre qué herramientas están disponibles de uno o más servidores MCP y pasa el contexto relevante de las herramientas al LLM. Luego, el LLM decide qué hacer y genera una llamada de herramienta estructurada con parámetros. El cliente MCP envía esa llamada de herramienta al servidor MCP, que la ejecuta contra el sistema descendente y devuelve el resultado en un formato predecible. El cliente traslada el resultado de vuelta al LLM, que hace otra llamada de herramienta o produce la respuesta final al usuario.

¿Qué es el flujo de seguridad MCP?

El flujo de seguridad MCP es el conjunto de controles, mejores prácticas y pasos arquitectónicos necesarios para implementar el Protocolo de Contexto de Modelos de manera segura. Comienza con identificación fuerte, consentimiento y ámbitos de privilegio mínimo para que el servidor MCP actúe en nombre del usuario en lugar de usar permisos de servicio amplios. Incluye manejo seguro de tokens y protecciones de sesión para reducir el riesgo de traspaso de tokens, secuestro de sesiones o inyección de eventos. Finalmente, depende de la aplicación y la visibilidad, incluyendo listas de permitidos de herramientas, validación de entrada y salida, aislamiento para servidores locales y un registro centralizado que vincula prompts a llamadas de herramientas y acciones descendentes para investigación y respuesta a incidentes.