I team di sicurezza sono sommersi dalla telemetria: log del cloud, eventi degli endpoint, tracce di audit SaaS, segnali di identità e dati di rete. Eppure molti programmi continuano a riversare tutto in un SIEM, sperando che le rilevazioni risolvano i problemi in seguito.

Il problema è che “più dati nel SIEM” non si traduce automaticamente in una migliore rilevazione. Spesso si traduce in caos. Molti SOC ammettono di non sapere nemmeno cosa faranno con tutti quei dati una volta acquisiti. Il SANS 2025 Global SOC Survey riferisce che il 42% dei SOC riversa tutti i dati in entrata in un SIEM senza un piano per il recupero o l’analisi. Senza un controllo a monte sulla qualità, struttura e indirizzamento, il SIEM diventa una discarica in cui input disordinati creano risultati disordinati: falsi positivi, rilevazioni fragili e contesto mancante nei momenti più critici.

Questa pressione si riflette direttamente nell’esperienza degli analisti. Un sondaggio Devo ha trovato che l’83% dei difensori informatici sono sopraffatti dal volume degli avvisi, falsi positivi e contesto mancante, e l’85% trascorre molto tempo a raccogliere e collegare prove solo per rendere attuabili gli avvisi. Persino la meccanica della rilevazione basata su SIEM può giocare contro di te. Gli eventi devono essere raccolti, analizzati, indicizzati e archiviati prima che siano ricercabili e correlabili in modo affidabile.

Il costo fa parte della stessa storia. Forrester nota che “Come riduciamo i costi di ingestione del nostro SIEM?” è una delle principali domande di indagine ricevute dai clienti. La risposta pratica è la gestione della pipeline dei dati per la sicurezza: instradare, ridurre, redare, arricchire e trasformare i log prima che raggiungano il SIEM. Se fatto bene, ciò riduce la spesa e rende la telemetria utilizzabile applicando campi coerenti, schemi stabili e pipeline più salutari in modo che i dati si trasformino in rilevazioni.

La domanda spinge i team di sicurezza a prendere in prestito un’idea familiare dal mondo dei dati. ETL sta per Estrazione, Trasformazione, Caricamento. Estrae i dati da più fonti, li trasforma in un formato coerente e poi li carica in un sistema di destinazione per analisi e reportistica. IBM descrive ETL come un modo per consolidare e preparare i dati, e osserva che ETL è spesso orientato in batch e può essere dispendioso in termini di tempo quando gli aggiornamenti devono essere frequenti. La sicurezza ha sempre più bisogno della versione in tempo reale di questo concetto perché un segnale di sicurezza perde valore quando arriva in ritardo.

Questo è il motivo per cui lo streaming di eventi è diventato così rilevante. Apache Kafka vede lo streaming di eventi come catturare eventi in tempo reale, memorizzare flussi in modo durevole, elaborarli in tempo reale o successivamente, e instradarli verso diverse destinazioni. In termini di sicurezza, ciò significa che puoi normalizzare e arricchire la telemetria prima che le rilevazioni dipendano da essa, monitorare la salute della telemetria in modo che il SOC non rimanga al buio, e instradare i dati giusti al posto giusto per la risposta, la caccia o la conservazione.

Qui è dove le Security Data Pipeline Platforms (SDPP) entrano in gioco. Una SDPP è la soluzione collocata tra fonti e destinazioni che trasforma la telemetria grezza in dati governati e pronti per la sicurezza. Gestisce l’ingestione, la normalizzazione, l’arricchimento, l’instradamento, la stratificazione e la salute dei dati in modo che i sistemi a valle possano fare affidamento su eventi puliti e coerenti invece di compensare schemi rotti e contesti mancanti.

Cos’è una Security Data Pipeline Platform (SDPP)?

Una Security Data Pipeline Platform (SDPP) è un sistema centralizzato che assorbe la telemetria di sicurezza da molte fonti, la elabora in volo e la consegna a una o più destinazioni, inclusi SIEM, XDR, SOAR e Data Lakes. Il compito della SDPP è prendere i dati di sicurezza grezzi man mano che arrivano, formattarli correttamente e consegnarli a valle in una forma coerente, arricchita e pronta per la rilevazione e la risposta. La differenza è sottile ma importante. Invece di trattare la gestione dei log come “raccolta e memorizzazione”, una SDPP la tratta come “raccolta, miglioramento e quindi distribuzione.”

Nella pratica, le SDPP supportano comunemente:

- Raccolta da agenti, API, syslog, flussi cloud e bus di messaggi

- Analisi e normalizzazione a schemi coerenti (ad es., concetti stile OCSF)

- Arricchimento con contesto di asset, identità, vulnerabilità e threat intel

- Filtraggio e campionamento per ridurre il rumore e controllare la spesa

- Instradamento verso più destinazioni (e formati diversi per destinazione)

A differenza delle pipeline dati legacy che spostano principalmente dati da un punto A a un punto B, una SDPP aggiunge intelligenza e governance. Tratta i dati di sicurezza come una capacità gestita che può essere standardizzata, osservata e adattata al cambiamento degli ambienti. Questo è importante poiché i team adottano strategie ibride SIEM più Data Lake, scalano l’infrastruttura cloud per rilevazione e risposta, e standardizzano la telemetria per correlazione e automazione.

Quali sono le capacità chiave di una Security Data Pipeline?

Una pipeline di dati di sicurezza trasforma la telemetria grezza in qualcosa di utilizzabile prima che arrivi nel tuo stack di sicurezza. Le pipeline più efficaci fanno due cose contemporaneamente. Migliorano la qualità dei dati e controllano dove vanno i dati, quanto a lungo confluiscono e come appaiono quando arrivano.

Ingestione su larga scala

Una moderna pipeline di dati di sicurezza deve raccogliere continuamente, non occasionalmente. Ciò significa log cloud, flussi di audit SaaS, telemetria degli endpoint, segnali di identità e dati di rete, raccolti tramite API, agenti e trasporti in streaming.

Trasformazione in volo

La trasformazione in volo è dove la pipeline guadagna il suo valore. Man mano che i dati fluiscono, i campi sono analizzati, gli attributi chiave sono estratti e i formati sono normalizzati in schemi stabili. Ciò riduce gli errori da dati incoerenti e mantiene la logica di correlazione portatile tra strumenti. Allo stesso tempo, il rumore può essere filtrato, gli eventi campionati e le regole di privacy o redazione applicate in modo controllato, misurabile e reversibile. Il risultato è dati puliti e affidabili pronti per il rilevamento e l’azione man mano che attraversano il sistema.

Arricchisci con il contesto

L’arricchimento trasforma il lavoro quotidiano del SOC portando il contesto ai dati prima che raggiungano gli analisti. Invece di spendere tempo a raccogliere manualmente informazioni, la pipeline aggiunge dettagli di identità e asset, etichette ambientali, approfondimenti sulle vulnerabilità e intelligence sulle minacce in modo che gli eventi siano pronti per il triage e la correlazione.

Instrada e effettua tier

L’instradamento è dove la telemetria diventa veramente governata. Invece di inviare tutti i dati a una singola destinazione, la pipeline applica politiche per consegnare gli eventi giusti a SIEM, XDR, SOAR e Data Lakes. I dati sono archiviati per valore, con percorsi di retention chiari per caldo, tiepido e freddo, e possono essere rapidamente accessibili quando le indagini lo richiedono. Gestendo formati diversi e sottoinsiemi per ciascun strumento, l’instradamento mantiene la pipeline organizzata, coerente e completamente gestita in ambienti, trasformando flussi grezzi in telemetria affidabile e attuabile.

Monitora la salute dei dati

Le pipeline hanno bisogno della loro osservabilità. Dati mancanti, cambiamenti imprevisti dello schema, o picchi e cali improvvisi possono creare punti ciechi che potrebbero essere notati solo durante un incidente. Una forte Security Data Pipeline Platform fornisce osservabilità su tutto il sistema, rendendo visibili questi problemi precocemente e supportando un rerouting sicuro se una destinazione fallisce.

Assistenza AI

I team sono sempre più a loro agio con l’assistenza AI pertinente nelle pipeline, specialmente per compiti ripetitivi come la generazione di parser quando i formati cambiano, il rilevamento della deriva, l’aggregazione di eventi simili e il QA. L’obiettivo non è il prendere decisioni autonomamente. Si tratta di un’operazione di pipeline più veloce e coerente con il controllo umano.

Rilevamento in flusso

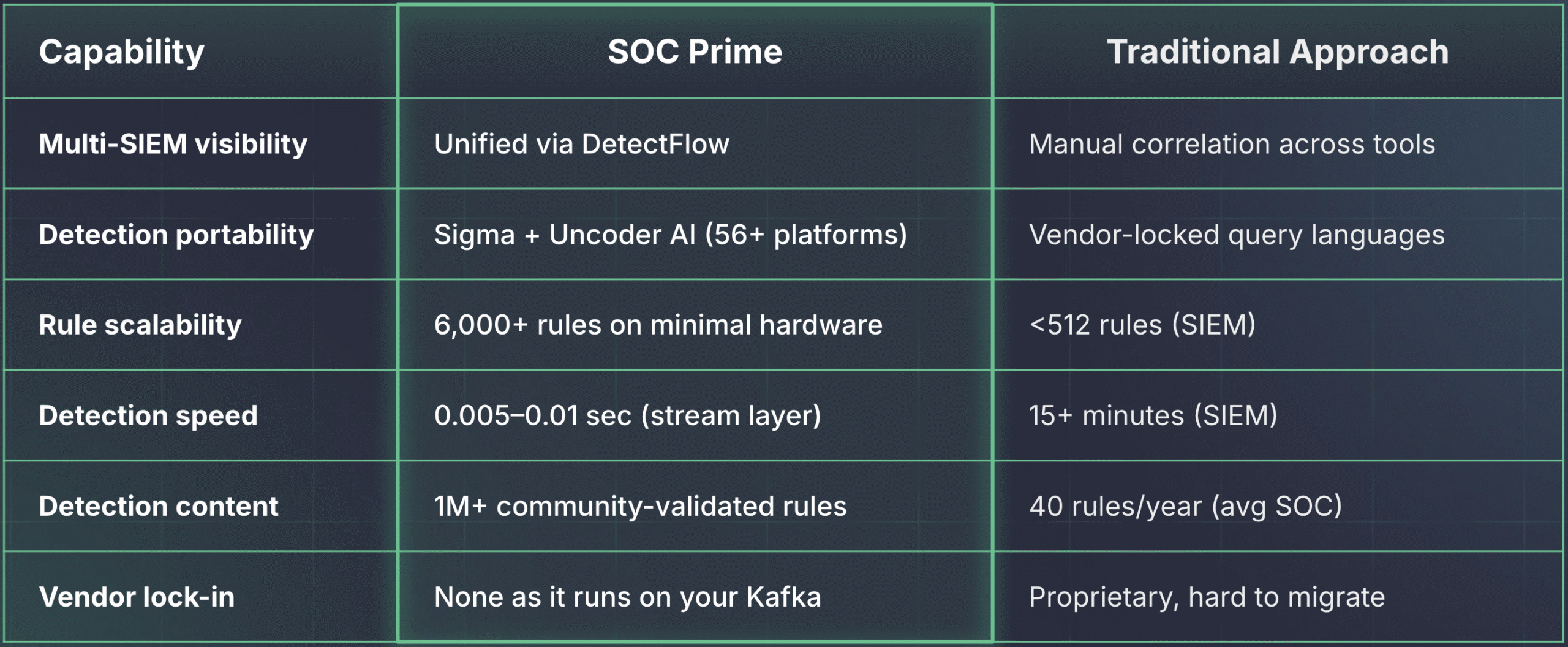

Alcuni team stanno ora eseguendo rilevamenti direttamente nel flusso di dati, trasformando le loro pipeline in livelli di rilevamento attivi. Strumenti come SOC Prime’s DetectFlow lo abilitano applicando decine di migliaia di regole Sigma a flussi Kafka live usando Apache Flink, taggando e arricchendo eventi in tempo reale prima che raggiungano sistemi come SIEM. L’obiettivo non è quello di sostituire l’analisi centralizzata, ma di dare priorità agli eventi critici prima, migliorare l’instradamento e ridurre il tempo medio di rilevamento (MTTD).

Quali sfide aiutano a risolvere le SDPP?

Le Security Data Pipeline Platforms esistono perché il dolore moderno dei SOC non è solo “troppi log.” È l’attrito tra raccolta dati e risultati reali di rilevamento. Quando la telemetria arriva in ritardo, è incoerente, costosa da memorizzare e difficile da interrogare su vasta scala, il SOC finisce per lavorare intorno ai dati invece di lavorare sulle minacce. Le principali sfide che le SDPP aiutano a risolvere sono le seguenti:

- I dati arrivano troppo tardi per essere utili. Il rilevamento basato su SIEM non è istantaneo. Gli eventi devono essere raccolti, analizzati, acquisiti, indicizzati e memorizzati prima che siano ricercabili e correlabili in modo affidabile. In ambienti reali, la correlazione può richiedere 15+ minuti a seconda del carico di ingestione ed elaborazione. Le SDPP riducono questo gap modellando la telemetria in volo in modo che i sistemi a valle ricevano eventi più puliti e normalizzati prima e instradando i dati ad alta priorità su percorsi più veloci quando necessario.

- “Conservare tutto” rompe il budget. La crescita dei dati sugli eventi rende l’approccio predefinito insostenibile. Anche se puoi pagare per acquisire tutto, finisci comunque per indicizzare e mantenere volumi enormi che non migliorano i risultati di rilevamento. Le SDPP aiutano i team a stabilire politiche chiare, in modo che gli eventi di sicurezza ad alto valore vadano a sistemi in tempo reale, mentre i log di massa o di lunga durata sono instradati a livelli più economici con reidratazione prevedibile durante le indagini.

- La logica di rilevamento non può tenere il passo con il volume dei log. I SOC medi implementano circa 40 regole all’anno, mentre i programmi di regole SIEM pratici e i limiti di prestazione spesso limitano la copertura utilizzabile a centinaia. Più telemetria arriva, ma il contenuto di rilevamento non scala allo stesso ritmo. Le SDPP chiudono il gap riducendo il rumore, stabilizzando gli schemi e preparando i dati in modo che ciascuna regola abbia un valore di segnale più alto e funzioni più coerentemente negli ambienti.

- ETL da solo non basta. ETL è ottimo per estrarre, trasformare e caricare dati per analisi e reportistica, spesso in batch. La sicurezza ha bisogno della versione continua di quell’idea. La telemetria arriva come un flusso, i formati cambiano frequentemente e le rilevazioni richiedono schemi coerenti più monitoraggio della salute per rimanere affidabili. Le SDPP complementano i flussi di lavoro in stile ETL fornendo elaborazione specifica per la sicurezza per i log in streaming, gestione della deriva dello schema e osservabilità operativa.

- Le minacce si evolvono più velocemente del tuo budget di query. Le campagne guidate dall’AI possono evolvere i payload malevoli in minuti, il che penalizza i flussi di lavoro che dipendono da cicli di query lenti e assemblaggio manuale delle prove. I SIEM impongono anche limiti pratici, inclusi limiti rigidi come meno di 1.000 query all’ora, a seconda della piattaforma e della licenza. Le SDPP aiutano rendendo ogni query più efficace tramite normalizzazione e arricchimento, e riducendo la necessità di query brute via instradamento intelligente, filtraggio e tagging a monte.

Quali sono i vantaggi di una Security Data Pipeline Platform?

Quando i team di sicurezza parlano di “troppi dati,” raramente intendono che vogliono meno visibilità. Intendono che il lavoro è diventato inefficiente. Gli analisti perdono tempo a unire il contesto insieme, le rilevazioni si rompono quando gli schemi cambiano, e i leader finiscono per pagare per l’ingestione che non riduce il rischio.

Una Security Data Pipeline Platform cambia la realtà quotidiana mettendo uno strato a capo di come la telemetria viene preparata e dove va. Per i team SOC, ciò significa che gli eventi arrivano più puliti, più coerenti e più facili da indagare. Per l’azienda, significa che puoi scalare la rilevazione e la conservazione senza trasformare la spesa SIEM e il rumore operativo in una busta paga permanente.

Pertanto, i principali vantaggi dell’utilizzo delle Security Data Pipeline Platforms includono i seguenti:

- Meno rumore, più segnale. Filtrando eventi di basso valore, deduplicando repliche e aggiungendo contesto prima che gli eventi raggiungano i sistemi di avviso, la SDPP aiuta gli analisti a concentrarsi su ciò che conta realmente.

- Spesa SIEM e di archiviazione inferiore. La pipeline controlla cosa viene inviato a destinazioni costose, instradando eventi ad alto valore ai sistemi in tempo reale mentre spinge la telemetria di massa a livelli meno costosi.

- Meno oneri e rifacimenti manuali. Le regole di trasformazione e instradamento vivono una volta nella pipeline invece di essere ricostruite tra strumenti e ambienti.

- Governance e conformità più forte. Le politiche centralizzate semplificano i controlli di privacy, i vincoli di residenza dei dati e le regole di conservazione.

- Meno punti ciechi e sorprese. Il rilevamento del silenzio e il monitoraggio della salute della telemetria rendono visibili i log mancanti, il drift e i fallimenti di consegna prima degli incidenti.

Come una Security Data Pipeline Platform può aiutare la tua azienda?

A livello aziendale, una Security Data Pipeline Platform riguarda la creazione di operazioni di sicurezza prevedibili. Quando la telemetria è governata a monte, la leadership riceve risposte più chiare a tre domande che di solito restano confuse negli ambienti maturi: quali dati contano, dove dovrebbero vivere e cosa dovrebbe costare operare su vasta scala.

Un impatto pratico è la pianificazione del budget che sopravvive alla crescita dei dati. Invece di trattare l’ingestione come una variabile incontrollabile, la pipeline rende il volume una politica gestita. È possibile impostare obiettivi, dimostrare cosa è stato ridotto e preservare il contesto che supporta il rilevamento e la compliance. Questa prevedibilità trasforma la riduzione dei costi in libertà operativa piuttosto che in un taglio rischioso.

Un altro impatto è la standardizzazione che sblocca il riuso. Quando la normalizzazione viene effettuata una volta e applicata ovunque, il contenuto di rilevamento e la logica di correlazione possono essere riutilizzati negli ambienti invece di essere riscritti per fonte o per destinazione. Ciò riduce i costi di manutenzione nascosti che rallentano le implementazioni e consumano il tempo di ingegneria.

Un terzo impatto è la flessibilità senza vincoli. L’instradamento e la stratificazione intelligente ti consentono di allineare i dati allo scopo, non ai limiti del fornitore. La telemetria ad alta priorità rimane calda per la risposta, i set di dati più ampi supportano la caccia in archivi più economici, e i log di lunga durata possono essere archiviati con un chiaro percorso di reidratazione per le indagini. La pipeline mantiene lo strato dati stabile mentre le destinazioni evolvono.

Infine, le pipeline supportano l’assicurazione operativa. Molte organizzazioni si preoccupano di più della telemetria mancante che della telemetria rumorosa perché i fallimenti silenziosi creano punti ciechi che emergono durante gli incidenti e gli audit. Una pipeline che monitora la salute della fonte e la deriva rende visibili i gap presto e migliora la fiducia nei report di sicurezza.

Sbloccare più valore SDPP con SOC Prime DetectFlow

Le pipeline di dati di sicurezza già ti aiutano a raccogliere, formare e instradare la telemetria con intento. SOC Prime’s DetectFlow aggiunge uno strato di rilevamento in flusso che trasforma la tua data pipeline in una rilevamento pipeline. Esegue regole Sigma su flussi Kafka live usando Apache Flink, tagga e arricchisce eventi corrispondenti in volo e instrada corrispondenze ad alta priorità a valle senza cambiare la tua architettura di ingestione SIEM.

Questo mira direttamente al divario di copertura della rilevazione. Ci sono 216 tecniche MITRE ATT&CK e 475 sotto-tecniche, eppure il SOC medio implementa ~40 regole all’anno, e molti SIEM iniziano a lottare intorno a ~500 regole personalizzate. DetectFlow è costruito per eseguire decine di migliaia di regole Sigma a velocità di flusso con MTTD sotto il secondo rispetto ai 15+ minuti comuni nelle pipeline SIEM-first. Poiché scala con la tua infrastruttura, eviti i limiti del fornitore, mantieni i dati nel tuo ambiente, supporti implementazioni isolate o collegate al cloud, e sblocchi fino a 10× la capacità delle regole sull’infrastruttura esistente.

Per ulteriori dettagli, contattaci a sales@socprime.com o inizia il tuo viaggio su socprime.com/detectflow.