Les équipes de sécurité sont submergées par la télémétrie : journaux cloud, événements des points de terminaison, pistes d’audit SaaS, signaux d’identité et données réseau. Pourtant, de nombreux programmes continuent de tout envoyer dans un SIEM, espérant que les détections s’en chargeront plus tard.

Le problème est que « plus de données dans le SIEM » ne se traduit pas automatiquement par une meilleure détection. Cela se traduit souvent par le chaos. De nombreux SOC admettent qu’ils ne savent même pas ce qu’ils feront de toutes ces données une fois qu’elles sont ingérées. La SANS 2025 Global SOC Survey rapporte que 42% des SOCs déversent toutes les données entrantes dans un SIEM sans plan de récupération ou d’analyse. Sans contrôle préalable sur la qualité, la structure et le routage, le SIEM devient un dépotoir où des entrées désordonnées créent des résultats désordonnés : faux positifs, détections fragiles et manque de contexte lorsque c’est le plus important.

Cette pression se manifeste directement dans l’expérience de l’analyste. Une enquête de Devo a révélé que 83% des défenseurs cybernétiques sont submergés par le volume des alertes, les faux positifs et le manque de contexte, et que 85% passent un temps considérable à rassembler et connecter des preuves juste pour rendre les alertes exploitables. Même la mécanique de la détection basées sur SIEM peut jouer contre vous. Les événements doivent être collectés, analysés, indexés et stockés avant qu’ils ne soient recherchables et corrélables de manière fiable.

Le coût fait partie de la même histoire. Forrester indique que «Comment réduire nos coûts d’ingestion SIEM ? » est l’une des principales questions posées par ses clients. La réponse pratique est la gestion des pipelines de données pour la sécurité : acheminer, réduire, expurger, enrichir et transformer les journaux avant qu’ils n’atteignent le SIEM. Bien fait, cela réduit les dépenses et rend la télémétrie utilisable en appliquant des champs cohérents, des schémas stables et des pipelines plus sains, afin que les données se transforment en détections.

Cette demande pousse les équipes de sécurité à emprunter une idée familière du monde des données. ETL signifie Extraction, Transformation, Chargement. Il extrait des données de plusieurs sources, les transforme dans un format cohérent, puis les charge dans un système cible pour l’analyse et le reporting. IBM décrit l’ETL comme un moyen de consolider et de préparer les données, et note que l’ETL est souvent orienté par lots et peut être chronophage lorsque les mises à jour doivent être fréquentes. La sécurité a de plus en plus besoin de la version en temps réel de ce concept car un signal de sécurité perd de sa valeur lorsqu’il arrive en retard.

C’est pourquoi le streaming d’événements est devenu si pertinent. Apache Kafka considère le streaming d’événements comme la capture des événements en temps réel, le stockage des flux de manière durable, leur traitement en temps réel ou plus tard, et leur routage vers différentes destinations. En termes de sécurité, cela signifie que vous pouvez normaliser et enrichir la télémétrie avant que les détections ne dépendent d’elle, surveiller la santé de la télémétrie pour que le SOC ne soit pas aveugle, et acheminer les bonnes données au bon endroit pour la réponse, la chasse ou la conservation.

C’est ici que les plateformes de pipeline de données de sécurité (SDPP) interviennent. Une SDPP est la solution située entre les sources et les destinations qui transforme la télémétrie brute en données prêtes pour la sécurité. Elle gère l’ingestion, la normalisation, l’enrichissement, le routage, la hiérarchisation et la santé des données pour que les systèmes en aval puissent se fier à des événements propres et cohérents plutôt que de compenser des schémas cassés et un manque de contexte.

Qu’est-ce qu’une plateforme de pipeline de données de sécurité (SDPP) ?

Une plateforme de pipeline de données de sécurité (SDPP) est un système centralisé qui ingère la télémétrie de sécurité de nombreuses sources, la traite en vol et la livre à une ou plusieurs destinations, y compris SIEM, XDR, SOAR et Data Lakes. Le travail de la SDPP est de prendre les données de sécurité brutes à leur arrivée, de les façonner correctement, et de les livrer en aval sous une forme cohérente, enrichie et prête pour la détection et la réponse. Le changement est subtil mais important. Au lieu de traiter la gestion des journaux comme « collecter et stocker », une SDPP la traite comme « collecter, améliorer, puis distribuer ».

En pratique, les SDPP supportent communément :

- La collecte à partir d’agents, APIs, syslog, flux cloud, et bus de messages

- Analyse et normalisation à des schémas cohérents (par exemple, concepts de style OCSF)

- Enrichissement avec le contexte d’actifs, identité, vulnérabilités, et renseignement sur les menaces

- Filtrage et échantillonnage pour réduire le bruit et contrôler les dépenses

- Routage vers plusieurs destinations (et différents formats par destination)

Contrairement aux pipelines de données traditionnels qui se contentent de déplacer des données d’un point A à un point B, une SDPP ajoute de l’intelligence et de la gouvernance. Elle traite les données de sécurité comme une capacité gérée qui peut être standardisée, observée, et adaptée à mesure que les environnements changent. Cela est important alors que les équipes adoptent des stratégies SIEM hybride plus Data Lake, évoluent les infrastructures cloud pour la détection et la réponse, et standardisent la télémétrie pour la corrélation et l’automatisation.

Quelles sont les capacités clés d’un pipeline de données de sécurité ?

Un pipeline de données de sécurité transforme la télémétrie brute en quelque chose d’utilisable avant qu’elle n’atteigne votre pile de sécurité. Les pipelines les plus efficaces font deux choses à la fois. Ils améliorent la qualité des données et contrôlent où les données vont, combien de temps elles restent et à quoi elles ressemblent à leur arrivée.

Ingestion à grande échelle

Un pipeline de données de sécurité moderne doit collecter en continu, et non occasionnellement. Cela signifie des journaux cloud, des flux d’audit SaaS, de la télémétrie des points de terminaison, des signaux d’identité et des données réseau, extraits via APIs, agents et transports en streaming.

Transformation en vol

La transformation en vol est là où le pipeline gagne en valeur. À mesure que les données circulent, les champs sont analysés, les attributs clés sont extraits, et les formats sont normalisés en schémas stables. Cela réduit les erreurs dues à des données incohérentes et garde la logique de corrélation portable à travers les outils. En même temps, le bruit peut être filtré, les événements échantillonnés, et les règles de confidentialité ou de réduction appliquées de manière contrôlée, mesurable et réversible. Le résultat est des données propres et fiables, prêtes pour la détection et l’action à mesure qu’elles circulent dans le système.

Enrichir avec du contexte

L’enrichissement transforme le travail quotidien du SOC en apportant du contexte aux données avant qu’elles n’atteignent les analystes. Au lieu de passer du temps à rassembler manuellement des informations, le pipeline ajoute des détails sur l’identité et les actifs, des tags d’environnement, des perspectives de vulnérabilités et du renseignement sur les menaces pour que les événements soient prêts pour le tri et la corrélation.

Routage et hiérarchisation

Le routage est l’endroit où la télémétrie devient véritablement gouvernée. Au lieu d’envoyer toutes les données vers une seule destination, le pipeline applique des politiques pour livrer les bons événements à SIEM, XDR, SOAR et Data Lakes. Les données sont stockées par valeur, avec des chemins de conservation clairs chaud, tiède et froid, et peuvent être accédées rapidement lorsque des enquêtes le nécessitent. En manipulant différents formats et sous-ensembles pour chaque outil, le routage garde le pipeline organisé, cohérent et entièrement géré à travers les environnements, transformant les flux bruts en télémétrie fiable et exploitable.

Surveiller la santé des données

Les pipelines ont besoin de leur propre observabilité. Les données manquantes, les changements de schéma inattendus, ou les pics et baisses soudains peuvent créer des angles morts qui peuvent ne se faire remarquer que lors d’un incident. Une plateforme de pipeline de données de sécurité robuste offre une observabilité à travers le système, rendant ces problèmes visibles tôt et supportant le reroutage sûr si une destination échoue.

Assistance AI

Les équipes sont de plus en plus à l’aise avec l’assistance AI pertinente dans les pipelines, surtout pour les tâches répétitives comme la génération de l’analyseur lorsque les formats changent, la détection de dérive, le regroupement d’événements similaires, et le QA. Le but n’est pas la prise de décision autonome. C’est une opération de pipeline plus rapide et plus cohérente avec un contrôle humain.

Détection en flux

Certaines équipes exécutent maintenant des détections directement dans le flux de données, transformant leurs pipelines en couches de détection active. Des outils tels que DetectFlow de SOC Prime permettent cela en appliquant des dizaines de milliers de règles Sigma à des flux Kafka en direct utilisés par Apache Flink, taguant et enrichissant les événements en temps réel avant qu’ils n’atteignent des systèmes tels que SIEM. Le but n’est pas de remplacer l’analyse centralisée, mais de prioriser les événements critiques plus tôt, d’améliorer le routage et de réduire le temps moyen de détection (MTTD).

Quels défis les SDPPs aident-ils à résoudre ?

Les plateformes de pipeline de données de sécurité existent parce que la douleur des SOC modernes n’est pas seulement « trop de journaux ». C’est la friction entre la collecte de données et les résultats réels de la détection. Lorsque la télémétrie arrive en retard, est incohérente, coûteuse à stocker et difficile à interroger à grande échelle, le SOC finit par contourner les données au lieu de travailler sur les menaces. Les principaux défis auxquels les SDPPs aident à résoudre sont les suivants :

- Les données arrivent trop tard pour être utiles. La détection basée sur SIEM n’est pas instantanée. Les événements doivent être collectés, analysés, ingérés, indexés et stockés avant d’être recherchables et corrélables de manière fiable. Dans des environnements réels, la corrélation peut prendre plus de 15 minutes selon la charge d’ingestion et de traitement. Les SDPPs réduisent cet écart en façonnant la télémétrie en vol pour que les systèmes en aval reçoivent des événements plus propres et normalisés plus tôt, et en acheminant les données prioritaires sur des chemins plus rapides lorsque cela est nécessaire.

- « Stocker tout » casse le budget. La croissance des données d’événement rend l’approche par défaut inabordable. Même si vous pouvez payer pour ingérer tout, vous finissez par indexer et retenir des volumes énormes qui n’améliorent pas les résultats de détection. Les SDPPs aident les équipes à établir des politiques claires pour que les événements de sécurité à forte valeur ajoutée aillent vers des systèmes en temps réel tandis que les journaux volumineux ou à longue rétention sont acheminés vers des niveaux moins chers avec une réhydratation prévisible pendant les enquêtes.

- La logique de détection ne peut pas suivre le volume des journaux. Les SOC moyens déploient environ 40 règles par an, tandis que les programmes de règles SIEM pratiques et les limites de performance plafonnent souvent la couverture utilisable dans les centaines. Plus de télémétrie arrive, mais le contenu des détections ne s’évolue pas au même rythme. Les SDPPs comblent cet écart en réduisant le bruit, en stabilisant les schémas et en préparant les données pour que chaque règle ait une valeur de signal plus élevée et fonctionne de manière plus cohérente à travers les environnements.

- L’ETL à lui seul n’est pas suffisant. L’ETL est excellent pour extraire, transformer et charger des données pour l’analyse et le reporting, souvent par lots. La sécurité a besoin de la version continue de cette idée. La télémétrie arrive sous forme de flux, les formats changent fréquemment, et les détections ont besoin de schémas cohérents plus la surveillance de la santé pour rester fiables. Les SDPPs complètent les flux de travail de style ETL en fournissant un traitement spécifique à la sécurité pour les journaux en flux, la gestion de la dérive des schémas et l’observabilité opérationnelle.

- Les menaces itèrent plus vite que votre budget de requêtes. Les campagnes pilotées par l’IA peuvent faire évoluer des charges malveillantes en quelques minutes, ce qui pénalise les flux de travail dépendant de cycles de requêtes lents et de pièces de preuve manuelles. Les SIEM imposent également des plafonds pratiques, y compris des plafonds rigides comme moins de 1 000 requêtes par heure, selon la plateforme et la licence. Les SDPP aident en rendant chaque requête plus efficace grâce à la normalisation et à l’enrichissement, et en réduisant le besoin de requêtes de Force brute via le routage intelligent, le filtrage et le marquage en amont.

Quels sont les avantages d’une plateforme de pipeline de données de sécurité ?

Quand les équipes de sécurité parlent de « trop de données », elles ne veulent rarement dire qu’elles veulent moins de visibilité. Elles signifient que le travail est devenu inefficace. Les analystes perdent du temps à rassembler du contexte, les détections cassent lorsque les schémas dérivent, et les dirigeants finissent par payer pour des ingestions qui ne réduisent pas le risque.

Une plateforme de pipeline de données de sécurité change la réalité quotidienne en mettant une couche en charge de la façon dont la télémétrie est préparée et où elle va. Pour les équipes SOC, cela signifie que les événements arrivent plus propres, plus cohérents et plus faciles à enquêter. Pour l’entreprise, cela signifie que vous pouvez évoluer la détection et la rétention sans transformer la dépense SIEM et le bruit opérationnel en une charge permanente.

Par conséquent, les principaux avantages d’utiliser des plateformes de pipeline de données de sécurité incluent les suivants :

- Moins de bruit, plus de signal. En filtrant les événements de faible valeur, en dédupliquant les répétitions et en ajoutant du contexte avant que les événements n’atteignent les systèmes d’alerte, le SDPP aide les analystes à se concentrer sur ce qui compte vraiment.

- Moins de dépenses en SIEM et en stockage. Le pipeline contrôle ce qui est envoyé aux destinations coûteuses, acheminant les événements à forte valeur ajoutée vers les systèmes en temps réel tout en poussant la télémétrie volumineuse vers des niveaux moins chers.

- Moins de travail manuel et de révisions. Les règles de transformation et de routage vivent une fois dans le pipeline au lieu d’être reconstruites à travers les outils et les environnements.

- Gouvernance et conformité plus solides. Les politiques centralisées simplifient les contrôles de confidentialité, les contraintes de résidence des données et les règles de conservation.

- Moins d’angles morts et de surprises. Les détections de silence et la surveillance de la santé télémétrique font surface les journaux manquants, les dérives et les échecs de livraison avant que les incidents ne le fassent.

Comment une plateforme de pipeline de données de sécurité peut-elle aider votre entreprise ?

À un niveau commercial, une plateforme de pipeline de données de sécurité vise à rendre les opérations de sécurité prévisibles. Lorsque la télémétrie est gouvernée en amont, la direction obtient des réponses plus claires à trois questions qui restent souvent floues dans les environnements matures : quelles données comptent, où elles devraient séjourner et combien elles devraient coûter pour fonctionner à grande échelle.

Un impact pratique est une planification budgétaire qui survit à la croissance des données. Au lieu de considérer l’ingestion comme une variable incontrôlable, le pipeline fait du volume une politique gérée. Vous pouvez définir des cibles, prouver ce qui a été réduit et préserver le contexte qui soutient la détection et la conformité. Cette prévisibilité transforme la réduction des coûts en liberté opérationnelle au lieu d’une réduction risquée.

Un autre impact est la standardisation qui débloque la réutilisation. Lorsque la normalisation est effectuée une fois et appliquée partout, le contenu de détection et la logique de corrélation peuvent être réutilisés à travers les environnements au lieu d’être réécrits par source ou par destination. Cela réduit les coûts de maintenance cachés qui ralentissent les déploiements et drainent le temps d’ingénierie.

Un troisième impact est la flexibilité sans verrouillage. Le routage et la hiérarchisation intelligents vous permettent d’aligner les données à la finalité, et non aux limites des fournisseurs. La télémétrie à haute priorité reste chaude pour la réponse, des ensembles de données plus larges soutiennent la traque dans des magasins moins chers, et les journaux de longue rétention peuvent être archivés avec un chemin de réhydratation clair pour les enquêtes. Le pipeline garde la couche de données stable tandis que les destinations évoluent.

Enfin, les pipelines supportent l’assurance opérationnelle. De nombreuses organisations s’inquiètent davantage de la télémétrie manquante que de la télémétrie bruyante parce que les échecs silencieux créent des angles morts qui se manifestent lors d’incidents et d’audits. Un pipeline qui surveille la santé et la dérive des sources rend les lacunes visibles plus tôt et améliore la confiance dans les rapports de sécurité.

Déverrouiller plus de valeur SDPP avec SOC Prime DetectFlow

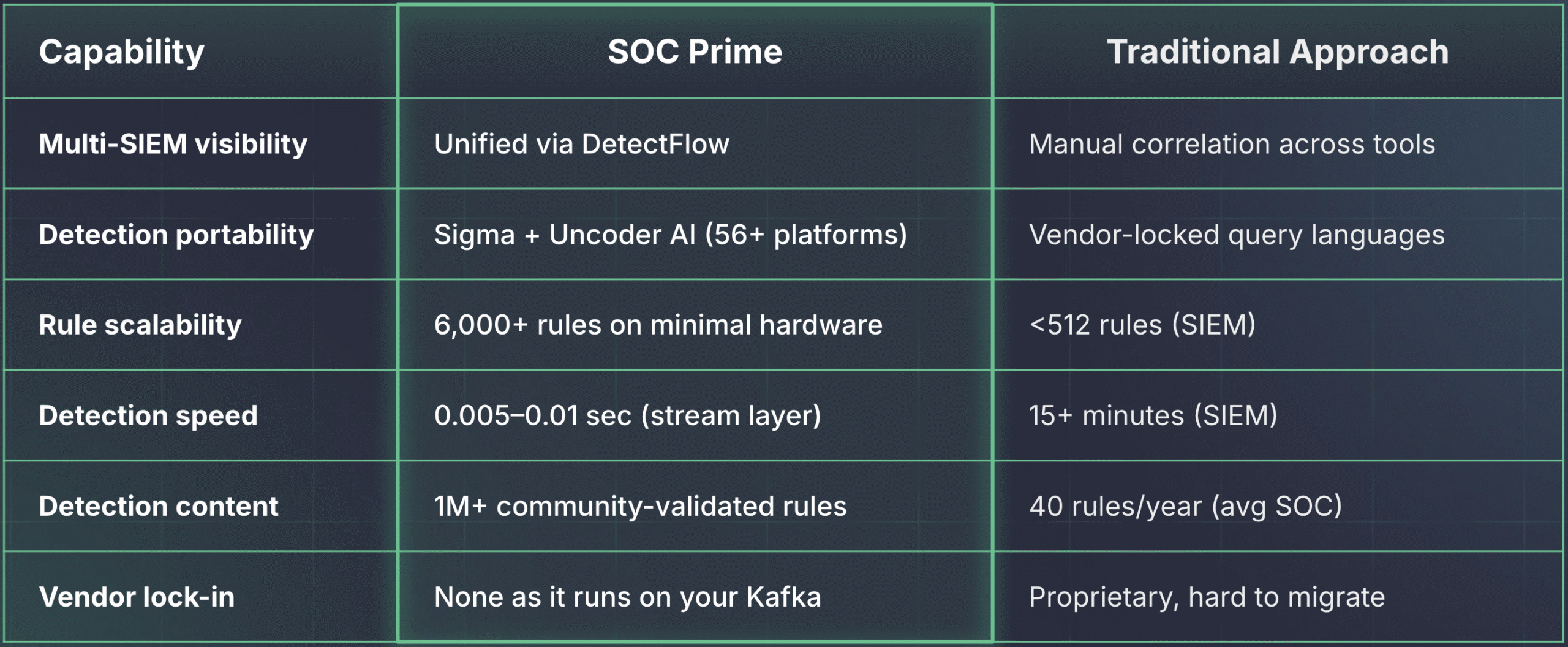

Les pipelines de données de sécurité vous aident déjà à collecter, modeler et acheminer la télémétrie avec intention. DetectFlow de SOC Prime ajoute une couche de détection en flux qui transforme votre pipeline de données en un pipeline de détection. Il exécute des règles Sigma sur des flux Kafka en direct utilisant Apache Flink, marque et enrichit en vol les événements correspondants, et achemine les correspondances prioritaires en aval sans modifier votre architecture d’ingestion SIEM.

Cela cible directement l’écart de couverture de détection. Il existe 216 techniques MITRE ATT&CK et 475 sous-techniques, pourtant le SOC moyen livre ~40 règles par an, et de nombreux SIEM commencent à rencontrer des difficultés autour de ~500 règles personnalisées. DetectFlow est conçu pour exécuter des dizaines de milliers de règles Sigma à la vitesse du flux avec un MTTD de sous-seconde contre 15+ minutes communes dans les pipelines centrés sur SIEM. Parce qu’il évolue avec votre infrastructure, vous évitez les limitations des fournisseurs, conservez les données dans votre environnement, supportez les déploiements connectés à l’air libre ou au cloud, et déverrouillez jusqu’à 10× la capacité de règles sur l’infrastructure existante.

Pour plus de détails, contactez-nous à sales@socprime.com ou commencez votre parcours à socprime.com/detectflow.